150 millions d’images, EMO, EMO, EMO.

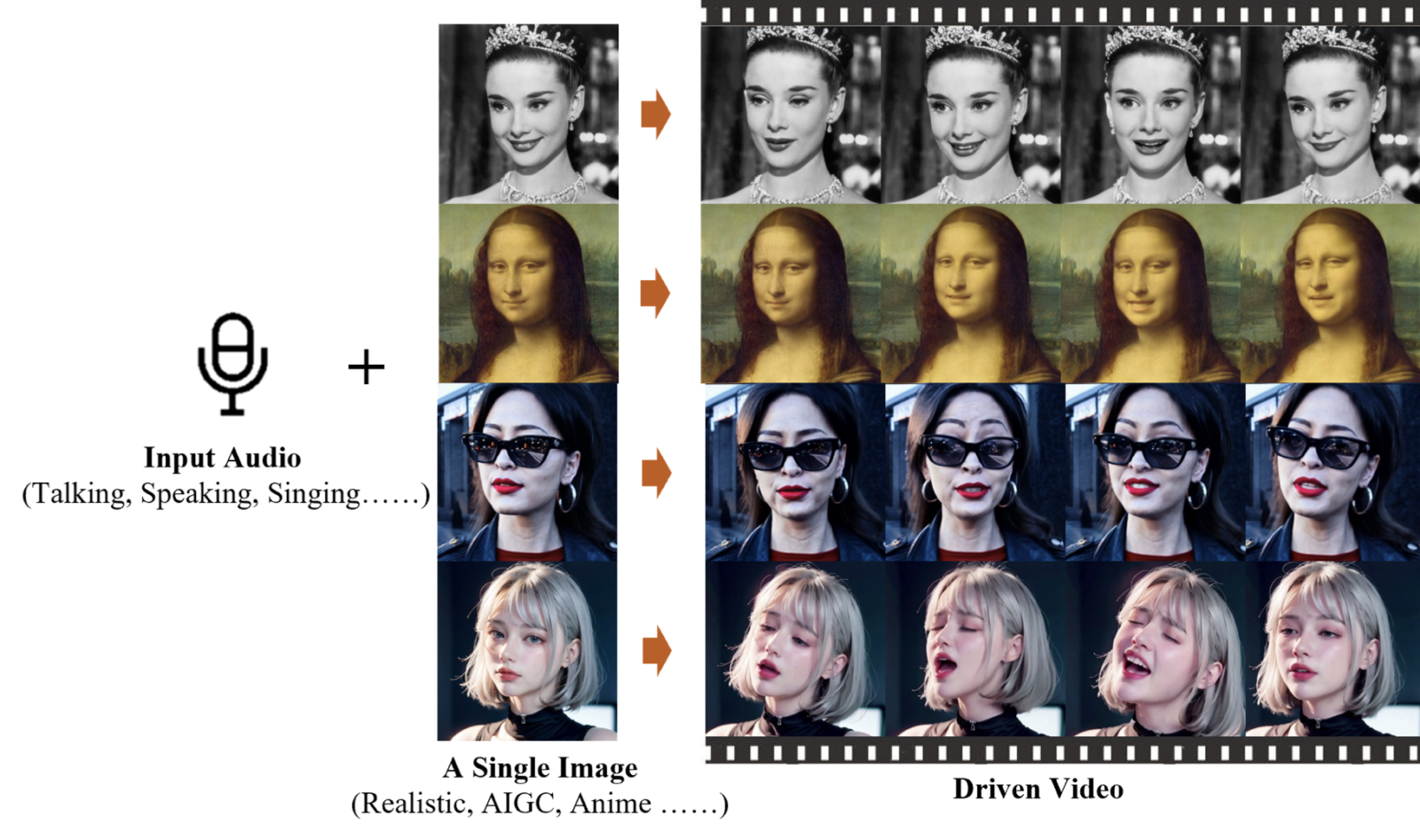

Vous avez sûrement dû voir passer sur X ces vidéos de célébrités qui parlent et chantent. Comme une impression de réalité, le Joker, la Joconde, Audrey Hepburn et bien d’autres, se retrouvent animés par une IA.

Le groupe Alibaba vient de dévoiler sa toute nouvelle intelligence artificielle : EMO. Cette IA est capable de transformer n’importe quelle image statique en une vidéo parlante et chantante – c’est un véritable artiste numérique. Alibaba a relevé le défi d’améliorer le réalisme et l’expressivité dans la génération de vidéos de personnes parlantes.

EMO se concentre sur la relation entre les indices audio et les mouvements faciaux pour capturer les expressions humaines et les styles faciaux. Cette IA propose une approche directe de synthèse audio-vidéo qui garantit des comportements fluides et réalistes. Le processus de création de vidéo commence par l’analyse de l’image de références pour identifier les mouvements du visage, puis, il traite l’audio pour déterminer les expressions faciales appropriées. Ainsi, les avatars générés par EMO sont capables de suivre des vidéos avec des chansons rapides ou même d’animer de vieux portraits, donnant l’impression que les personnages parlent ou chantent.

Just a while after Sora by OpenAi, It's been a busy period for the AI space with announcements from Alibaba, Google, Ideogram and lightrick.

— Nova (@Novaprayer_) March 1, 2024

Here are the most important developments that happened:

1. Researchers from alibaba unveiled EMO: Emote Portrait Alive by Alibaba, an AI… pic.twitter.com/AZz5AdiuoH

Alors ça c’est ouf.

— AI EXPLORER🤖 (@AiExplorerFR) February 28, 2024

Cette nouvelle IA créée par Alibaba peut faire chanter, parler et rapper n’importe quelle image à partir de n'importe quel fichier audio ! 🤯

Voici EMO : Emote Portrait Alive par Alibaba.

Exemple ci dessous avec DiCaprio qui s’anime pour rapper du Eminem👇 pic.twitter.com/4BAfMTASge

EMO by Alibaba is insane.

— Min Choi (@minchoi) February 29, 2024

It's not just AI lip sync, it expressively shows emotions, head motions, facial expressions, and even earring movements!

Can you trust what you see after watching these AI videos?

5 crazy examples:

1. AI Lady from Sora with OpenAI's Mira Murati voice pic.twitter.com/1NYI8VwfxQ

En bref, un modèle bien plus efficace que celui qui avait fait chanter le rédacteur en chef de la Réclame en 2020.

Dans une publication LinkedIn d’Eric Vyacheslav, ancien ingénieur chez Google, les internautes ont fait émerger, en réaction à l’annonce de EMO, des doutes concernant la moralité et l’éthique d’utiliser des personnages historiques pour générer ce style de vidéos dégradantes pour certaines. La question des deepfake se pose aussi, se demandant si cela ne va pas contribuer davantage à ces fausses vidéos qui circulent sur Internet et qui portent atteinte à des personnalités publiques.

Malgré ces critiques, l’IA EMO ouvre tout de même la voie vers une nouvelle innovation informatique, offrant de nouvelles possibilités pour la création artistique et l’expression individuelle.

![TANOSHI BUDOK[AI] CARDS, les 1ères battles de cartes culinaires japonaises, générées par IA TANOSHI BUDOK[AI] CARDS, les 1ères battles de cartes culinaires japonaises, générées par IA](https://d9m1iyeq935g9.cloudfront.net/720x470-mindoza-tanoshi-mea-site1721604816-logo.jpg)