L’erreur est humaine, le biais, algorithmique. Cependant, le point commun entre les deux reste l’humain. Après tout, l’homme façonne ces algorithmes, les nourrit de données qu’il sélectionne, et sont, en fin de compte, le reflet de ses propres “préjugés”.

À partir de là, comment marier l’efficacité de l’IA avec la richesse de la diversité culturelle ? C’est ce défi que Datawords s’est engagé à relever depuis 24 ans. Fondée sur la conviction que l’inclusion et le respect des différences culturelles sont les clés d’une communication réussie, l’entreprise a su intégrer l’IA générative à ses processus de création de contenus pour les marques (comme L’Oréal, Henkel, Colgate, Groupe Seb, LVMH), tout en conservant ce qui fait la force de l’humain comme garde-fou : l’intelligence émotionnelle.

Alexandre Crazover, associé-fondateur du groupe Datawords, nous explique comment le groupe accompagne les entreprises pour offrir des expériences véritablement personnalisées et respectueuses des cultures du monde entier.

Pourquoi Datawords a-t-elle été créée il y a 24 ans ?

Alexandre Crazover : Nous avons fondé Datawords avec cinq associés d’origines très diverses : une associée japonaise, une associée chinoise, un associé indien, un autre suisse-italien, un français de Bretagne et moi-même, d’origine est-européenne, mais né en France. Nous souhaitions combiner nos différences culturelles dans le domaine technologique et digital pour rendre les grandes entreprises plus pertinentes dans leur déploiement et leur croissance internationale. Nous nous appuyions sur des études, comme celles de McKinsey, qui démontrent que les entreprises avec une véritable diversité et inclusion à leur cœur affichent une meilleure croissance, y compris en bourse.

Dès le départ, chaque associé détenait une part égale dans l’entreprise, ce qui était bien plus qu’un simple exercice de « check the box » ou de storytelling. Les décisions étaient véritablement prises en tenant compte des perspectives culturelles de chacun. Lorsque nous présentions notre offre aux clients, surtout au début, il n’était pas rare que nous arrivions en groupe, et cela les convainquait que notre approche technologique était réellement différente.

Nous avons donc créé Datawords sur le concept « Everyone Matters », qui repose sur l’idée que chaque partie prenante – qu’il s’agisse de nos équipes, de nos clients, de nos actionnaires ou des communautés locales où nous sommes présents – a son importance. Par exemple, en Corée du Sud, il était essentiel d’avoir une équipe locale coréenne. Toute la création du groupe était guidée par un amour sincère des différences et la volonté de les intégrer dans la technologie.

Chacun a son propre parcours : d’un point de vue personnel, ma femme est noire et nos trois enfants sont métis. Cette expérience m’a encore plus convaincu que l’on s’enrichit à travers la diversité, que ce soit dans le domaine professionnel ou personnel.

Comment Datawords intègre-t-il l’IA dans ses processus de création de contenu pour les marques internationales ?

A.C. : Pour nous, l’IA est un levier qui accélère notre mission de création et de déploiement de contenus pour les grands groupes internationaux. Par exemple, elle peut améliorer les processus itératifs entre nos équipes lors de la phase créative, en générant davantage de concepts à sélectionner. L’IA intervient également dans nos outils pour augmenter le volume de contenus ou accélérer la production pour différents pays, tout en permettant à nos équipes de vérifier et de corriger ces contenus.

Globalement, elle est intégrée à toutes les étapes de production pour nous aider à travailler plus rapidement. Notre objectif est d’accompagner les grandes entreprises dans la production à grande échelle, couvrant jusqu’à 200 pays. Ainsi, l’IA devient un outil clé pour accomplir cette mission. Nous la voyons comme une véritable opportunité, car elle nous permet de personnaliser des contenus pour le monde entier. Nous l’intégrons à différents niveaux : dans les processus de contrôle, de création, et de déploiement.

L’IA nous aide également à réduire les coûts, un aspect crucial pour nos clients confrontés à des marchés moins performants dans certaines régions. Grâce à l’IA, ils peuvent maintenir le même niveau de production avec des coûts réduits, ou produire plus avec les mêmes ressources.

Quelles sont les stratégies de Datawords pour identifier et combattre les biais culturels dans les contenus générés par l’IA ?

A.C. : Chez Datawords, nous nous considérons comme des ingénieurs de l’intelligence collective et culturelle. Notre mission repose sur ce que nous appelons le « Responsible AI », qui consiste à éviter qu’une culture ne prenne le dessus sur une autre. Comme l’IA est souvent construite à partir de modèles anglophones, notre rôle, en couvrant plus de 200 pays, est parfois de rééquilibrer ces biais culturels, linguistiques ou socio-économiques. Pour cela, nous avons développé des outils spécifiques, comme LangTrust, un logiciel qui aide à analyser les modèles et à corriger les biais, que ce soit pour des grands groupes ou des plus petites entreprises.

Notre approche repose sur le multiculturalisme digital, qui va au-delà de la diversité : il s’agit d’inclure chaque culture dans la technologie et d’assurer que chaque internaute, où qu’il se trouve, interagisse avec des contenus dépourvus de biais culturels ou socio-économiques. C’est pourquoi nous avons une crédibilité particulière auprès de nos clients dans ce domaine, car cette approche fait partie intégrante de notre ADN.

Lorsque nous avons créé Datawords il y a 24 ans, notre concept, bien que sans IA à l’époque, était déjà basé sur « Everyone Matters ». Aujourd’hui, avec l’IA, nous renforçons cette approche en utilisant des outils, des processus de contrôle et ce que nous appelons le « dernier kilomètre » pour garantir que les messages sont véritablement adaptés à chaque marché, qu’il s’agisse de la Corée du Sud, de Dubaï ou du Canada. Ce ne doit pas être la simple traduction d’un concept, mais une communication réellement native. Nos ingénieurs spécialisés en IA travaillent spécifiquement sur ces enjeux de biais, afin de garantir que les contenus et les outils que nous utilisons respectent pleinement chaque culture.

Avez-vous des exemples concrets à nous partager ?

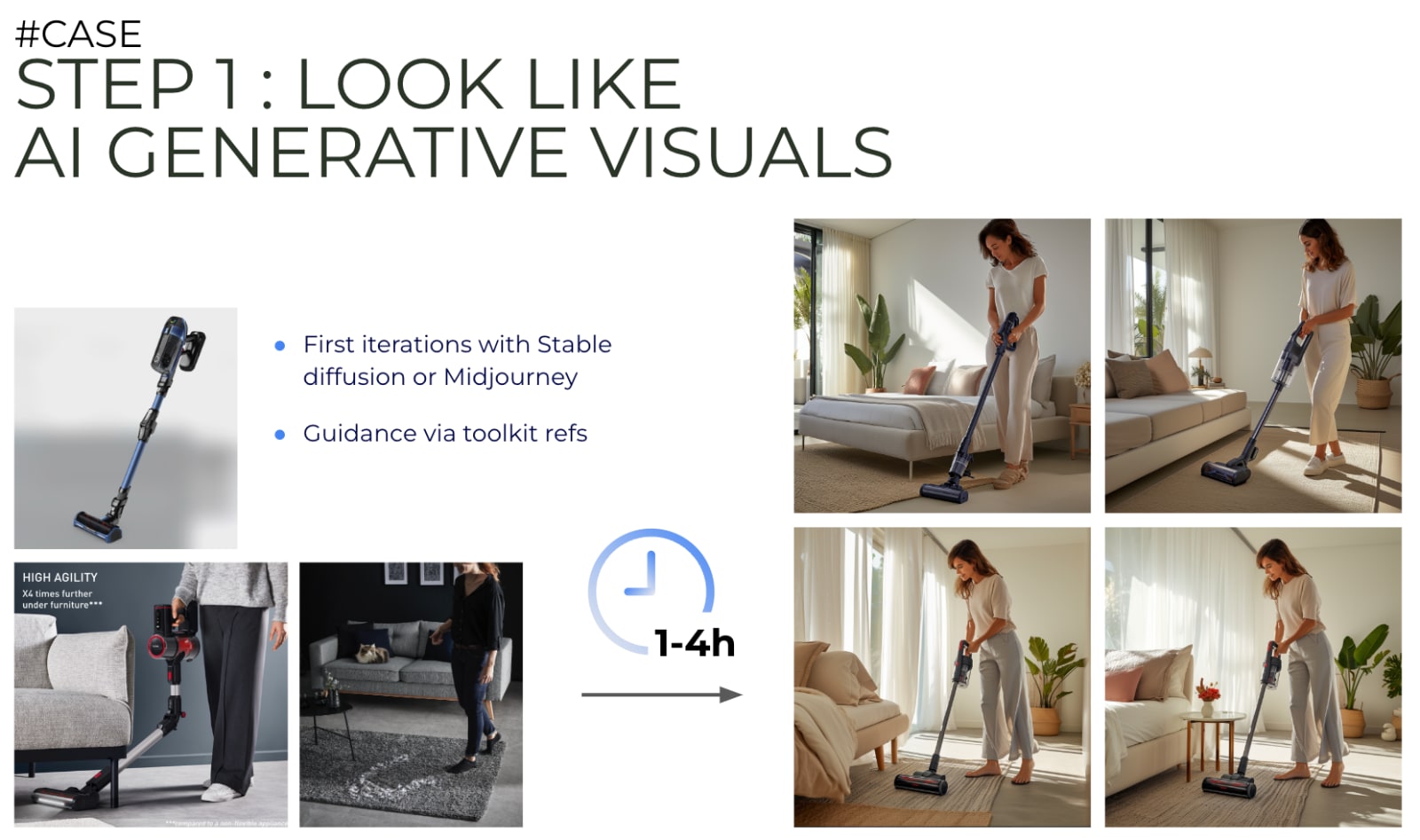

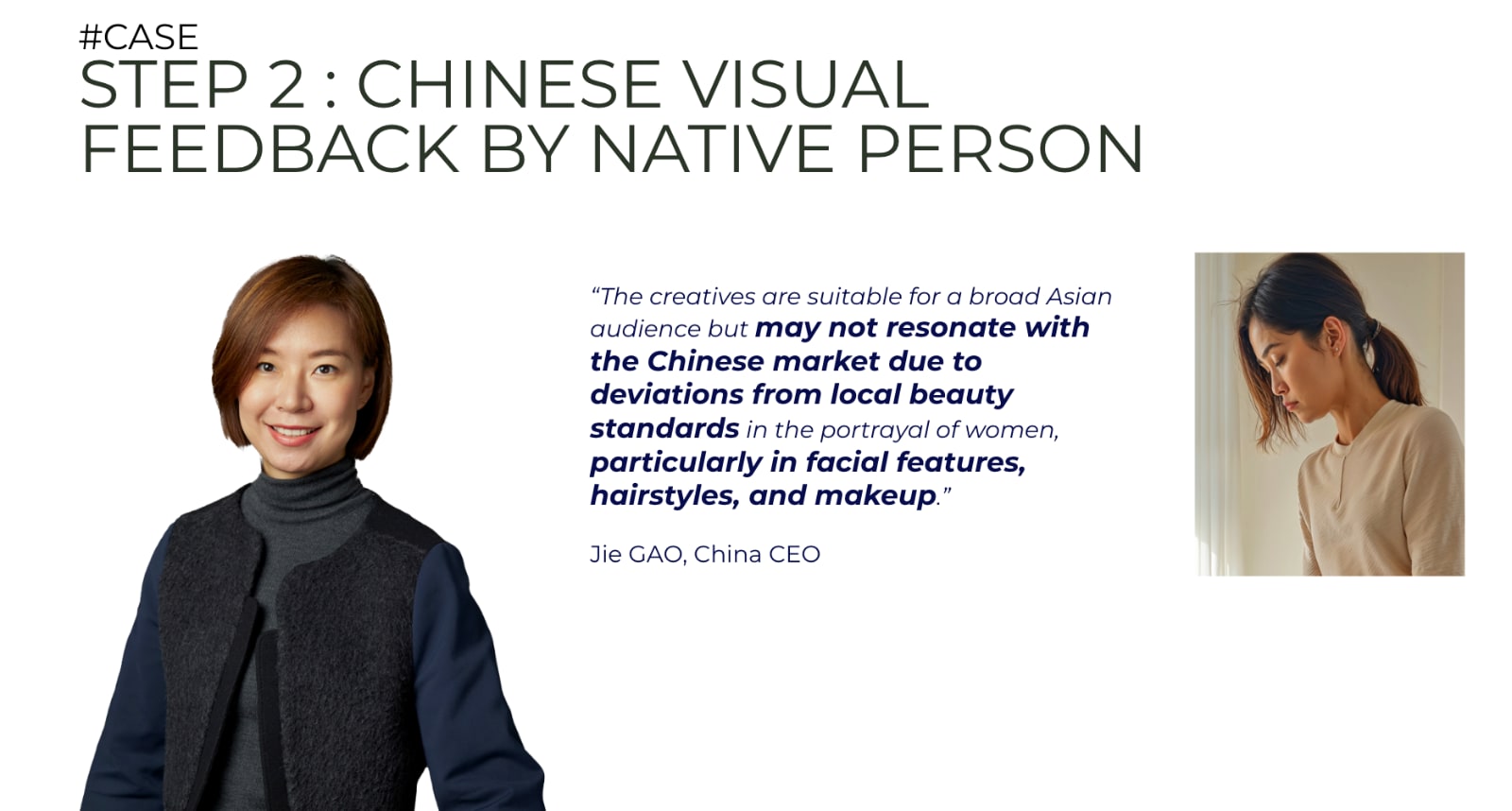

A.C. : Nous rencontrons ce genre de situations régulièrement. Par exemple, nous collaborons avec SEB, une grande marque française dans le secteur de l’électroménager, un client de longue date. Lors de la création de campagnes internationales avec eux, nous avons remarqué que certains visuels générés par l’IA montraient systématiquement des femmes avec des aspirateurs, alors que nous avions simplement demandé des images d’aspirateurs, sans spécifier de genre. Nous avons évidemment corrigé cela.

Un cas similaire s’est produit en Asie, où nous travaillons pour des grandes marques de cosmétiques. Les visuels générés étaient fortement stéréotypés par rapport à la réalité locale. L’IA repose sur des modèles et des contenus existants, ce qui a pour conséquence d’amplifier les biais déjà présents. Malheureusement, cela conduit à la multiplication de ces stéréotypes dans les visuels produits.

L’IA permet de produire plus rapidement et à moindre coût. Comment garantissez-vous que cette rapidité n’affecte pas la qualité et la pertinence locale du contenu ?

A.C. : Grâce à notre outil LangTrust, nous sommes en mesure d’effectuer un contrôle qualité rigoureux. Cet outil permet de combiner l’efficacité de l’IA avec l’expertise humaine, car nous croyons fermement en l’importance de cette synergie. Avec plus de 1 000 salariés répartis dans le monde entier – notamment à Tokyo, en Corée du Sud, en Europe, et aux États-Unis – nous faisons appel à nos propres équipes pour réaliser ces vérifications.

Bien que l’IA puisse parfois être utilisée pour renforcer ce contrôle, nous sommes convaincus que la clé du succès réside dans l’association de l’intelligence artificielle et de l’intelligence émotionnelle, ce que nous appelons « cultural intelligence ». Ainsi, nous privilégions toujours l’intervention humaine dans les étapes finales du processus, pour garantir la qualité et l’adaptation locale des contenus.

Justement, pensez-vous, qu’à terme, l’IA remplacera totalement l’humain dans le processus de localisation du contenu, ou y aura-t-il toujours un besoin d’expertise humaine ?

A.C. : Nous sommes convaincus que c’est la combinaison de l’intelligence artificielle et humaine qui garantit le succès. Nous ne croyons pas que l’IA remplacera entièrement l’intelligence humaine, car ce qui nous distingue avant tout, c’est notre intelligence émotionnelle. Cette dimension, qui nous rend également créatifs et artistiques, ne peut pas être reproduite à tous les niveaux par l’IA. C’est cette intelligence émotionnelle qui reste irremplaçable dans de nombreux aspects.

Comment évaluez-vous l’impact des différences culturelles sur les algorithmes d’IA et leur capacité à générer du contenu pertinent pour chaque marché ?

A.C. : Ce que nos clients attendent de nous, c’est de les guider dans le choix des outils les plus adaptés à chaque marché. Par exemple, ChatGPT est très performant pour les marchés américains, mais pour la culture espagnole, italienne ou peut-être allemande, nous trouvons que Mistral peut être plus pertinent. En Chine, nous utilisons encore d’autres outils, et nos tests réalisés avec LangTrust montrent que les résultats sont souvent bien meilleurs. De même, au Japon, nous avons recours à des solutions spécifiques.

Notre rôle est donc d’accompagner nos clients dans la sélection des outils les plus appropriés pour chaque culture, car nous avons constaté, grâce à nos équipes et à nos tests, qu’il existe de grandes différences de pertinence selon les cultures, les sous-cultures et les communautés.

Quels outils ou technologies Datawords utilise-t-il pour minimiser les risques d’erreurs culturelles dans les campagnes globales ?

A.C. : Comme évoqué précédemment, nous utilisons Mistral, Open AI, Gemini, mais aussi Ernie Bot (Chine), Tongyi Qianwen (Chine), HyperCLOVA (Corée du sud), Kakao Brain (Corée du sud) ou encore Rinna (Japon).

Pour nous, l’essentiel est d’abord de choisir le bon outil en fonction de la culture concernée. Cela s’applique également à tous les autres outils que nous utilisons. Par exemple, si un outil est très performant et largement utilisé à l’échelle mondiale, mais qu’il présente des limites culturelles, nous demandons à nos équipes de consacrer plus de temps à corriger ces biais. C’est là qu’intervient LangTrust, pour nous aider à ajuster ces différences culturelles. C’est un peu comme si nous avions des grilles d’évaluation nous permettant d’identifier quel outil est le plus efficace à l’échelle mondiale pour la génération d’images. Si c’est le cas, nous l’utiliserons, mais nous allouerons plus de temps à corriger les biais avec nos équipes locales, comme celles au Japon ou en Chine, pour nous assurer que les résultats soient culturellement adaptés.

Quelles sont, selon vous, les prochaines grandes évolutions en matière de localisation de contenu dans le contexte de l’IA et de la mondialisation ?

A.C. : Aujourd’hui, il s’agit d’une personnalisation extrême. On en parlait déjà avant, mais avec l’IA et la collaboration entre l’intelligence artificielle et nos équipes, nous sommes capables d’aller beaucoup plus loin dans cette personnalisation, que ce soit pour chaque culture ou sous-culture. C’est une tendance majeure pour nous.

Un autre point important est que beaucoup de personnes ont surestimé les capacités de l’IA au cours des 18 derniers mois. Maintenant, on se rend compte que, bien que l’IA soit une des révolutions les plus incroyables, elle ne peut pas fonctionner pleinement sans le contrôle humain. Ce décalage entre les promesses de l’IA et son application concrète a créé une certaine déception chez les entreprises : lors des tests et des proof of concept (POC), les dirigeants sont parfois déçus du retour sur investissement.

Une autre tendance que nous voyons émerger est la nécessité de combiner l’IA et l’humain pour garantir un investissement pertinent à l’échelle mondiale. Aujourd’hui, il arrive souvent que les résultats soient en deçà des attentes, et que l’on doive rapidement ajouter un processus de contrôle, ce qui donne l’impression que cette étape n’avait pas été anticipée. Chez nous, nous accompagnons les clients en suivant un processus structuré que nous appelons « Think, Shape and Deliver ». Cela permet de s’assurer que, dès le départ, les bonnes équipes sont impliquées au bon moment, afin d’éviter toute déception sur les résultats finaux.

Il y a quelque chose de rassurant finalement dans ce gap entre l’attente et la réalité. L’intelligence artificielle n’est pas encore prête à nous remplacer.

A.C. : C’est surprenant de voir à quel point l’importance de l’intelligence émotionnelle est fréquemment sous-estimée. Avec l’émergence de l’IA, certains ont tendance à réduire l’être humain à une simple machine ou à une composante industrielle, ce qui crée par la suite une certaine déception par rapport aux résultats obtenus. Pourtant, nous disposons de deux types d’intelligences : l’intelligence rationnelle (IQ) et l’intelligence émotionnelle (IE). Or, en mettant l’accent sur l’IA, beaucoup ont oublié que l’intelligence émotionnelle reste une dimension que l’IA est encore très loin d’atteindre.